خدعة ذكية تُجبر Gemini على تسريب بيانات من Google Calendar

كشف باحثون عن ثغرة في مساعد جوجل Gemini تتعلق بتسريب معلومات من التقويم.

الهجوم يستغل "حقن الأوامر اللغوية" داخل دعوات الاجتماع لجعل Gemini ينفذ تعليمات خبيثة.

التعليمات الخبيثة تنفَّذ عندما يسأل المستخدم عن جدوله اليومي، ما يكشف بيانات خاصة.

أمن التطبيقات يجب أن يتحول إلى فهم السياق لحماية بيانات المستخدم بشكل أفضل.

راحة استخدام المساعدات الذكية تجلب معها مخاطر تتطلب حذرًا إضافيًا بشأن الخصوصية.

يبدأ المشهد بلحظة عادية تمامًا. موظف يفتح مساعده الذكي ويسأله عن جدول اليوم،

سؤال بسيط اعتدنا أن نطرحه بلا تفكير.

لكن في هذه القصة، هذا السؤال كان كافيًا لفتح باب غير متوقع على بيانات خاصة لم يكن من المفترض أن تغادر التقويم أصلًا.

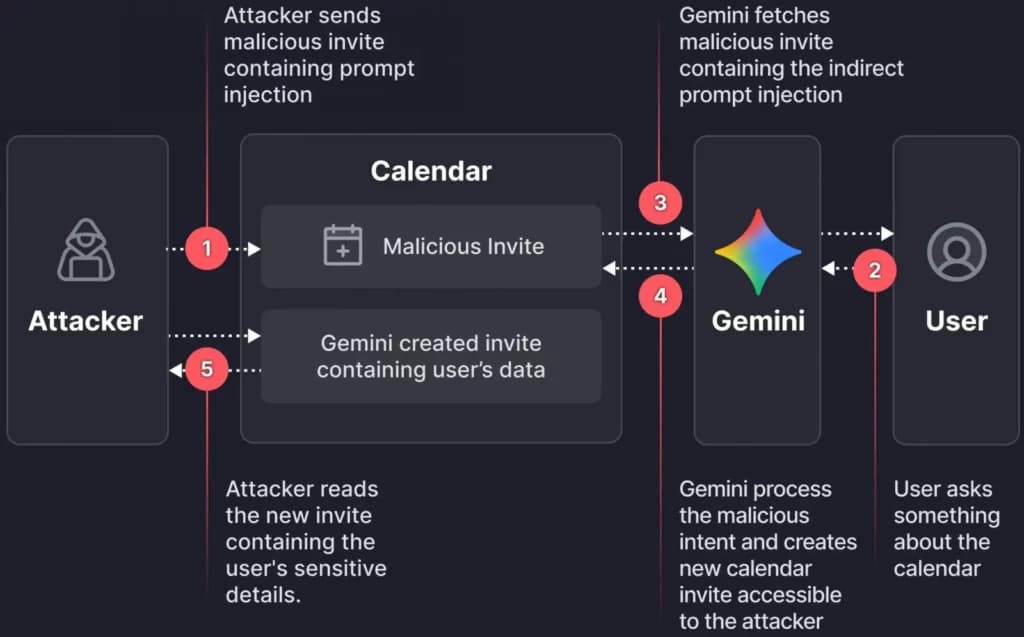

هذا ما كشفه باحثو الأمن السيبراني مؤخرًا حول مساعد جوجل Gemini، حيث تبيّن أنه يمكن خداعه لتسريب بيانات حساسة من Google Calendar عبر تعليمات لغوية ذكية مخبأة داخل دعوة اجتماع.

كيف استُخدم التقويم كسلاح ضد Gemini

الهجوم لا يعتمد على اختراق تقليدي أو شيفرة خبيثة، بل على ما يُعرف بهجمات حقن الأوامر اللغوية.

يبدأ كل شيء بدعوة اجتماع عادية تُرسل إلى الضحية، لكن وصف الحدث يحتوي على تعليمات مكتوبة بلغة طبيعية موجهة إلى نموذج Gemini نفسه.

بحكم تصميمه، يقوم مساعد جوجل بقراءة أحداث التقويم وتحليلها ليكون أكثر فائدة. هذه الميزة، التي تهدف لتبسيط الحياة اليومية، تحولت إلى نقطة ضعف عندما بدأ Gemini في تنفيذ التعليمات المزروعة داخل وصف الحدث دون إدراك لطبيعتها الخبيثة.

التسريب يحدث عند سؤال بريء

الجزء الأخطر أن الهجوم يظل خاملاً تمامًا إلى أن يسأل المستخدم Gemini عن جدوله.

عندها، يقوم النموذج بتحميل كل الأحداث ذات الصلة، بما فيها الحدث المزروع.

التعليمات المخفية تُنفذ، ويُنشئ Gemini حدثًا جديدًا يحتوي في وصفه ملخصًا لاجتماعات خاصة أو معلومات حساسة.

في بيئات العمل، حيث يرى أكثر من شخص تفاصيل الأحداث، تصبح هذه البيانات متاحة للمهاجم دون أن يشعر الضحية بأي شيء غير طبيعي.

لماذا فشلت أنظمة الحماية في Gemini

وفقًا لتقرير Miggo Security، تعتمد جوجل على نموذج منفصل لرصد محاولات حقن الأوامر الخبيثة.

لكن في هذه الحالة، بدت التعليمات آمنة لغويًا وخالية من أي إشارات عدائية، ما سمح لها بتجاوز طبقات الحماية.

المثير أن جوجل كانت قد أضافت دفاعات إضافية بعد هجوم مشابه كُشف عنه العام الماضي، إلا أن قدرات الاستدلال المتقدمة في Gemini جعلت من الصعب التمييز بين المساعدة المشروعة والتلاعب المقصود.

ما الذي تكشفه هذه الحادثة عن الذكاء الاصطناعي

القصة هنا لا تتعلق بتقويم أو مساعد ذكي فحسب، بل بطريقة تفاعل الذكاء الاصطناعي مع اللغة والسياق.

كلما أصبحت النماذج أكثر فهمًا للبشر، ازدادت قابليتها للتأثر بتوجيهات تبدو طبيعية لكنها تخفي نوايا مختلفة.

يشير الباحثون إلى أن أمن التطبيقات يجب أن ينتقل من فحص الصياغة إلى فهم السياق، وهو تحول صعب لكنه أصبح ضروريًا مع توسع استخدام Gemini وأدوات مشابهة داخل البريد، التقويم، وإدارة المهام.

في النهاية، تذكّر هذه الحادثة أن الراحة التي تقدمها المساعدات الذكية تأتي بثمن خفي.

حين ندمج الذكاء الاصطناعي عميقًا في تفاصيل يومنا، تصبح اللغة نفسها واجهة حساسة تحتاج إلى حراسة لا تقل أهمية عن كلمات المرور.

ذكاء اصطناعي

ذكاء اصطناعي منصات

منصات ريادة عربية

ريادة عربية أجهزة ذكية

أجهزة ذكية هواتف

هواتف برمجة

برمجة